Potrebna je velika računarska snaga da bi se simulirala ljudska inteligencija.

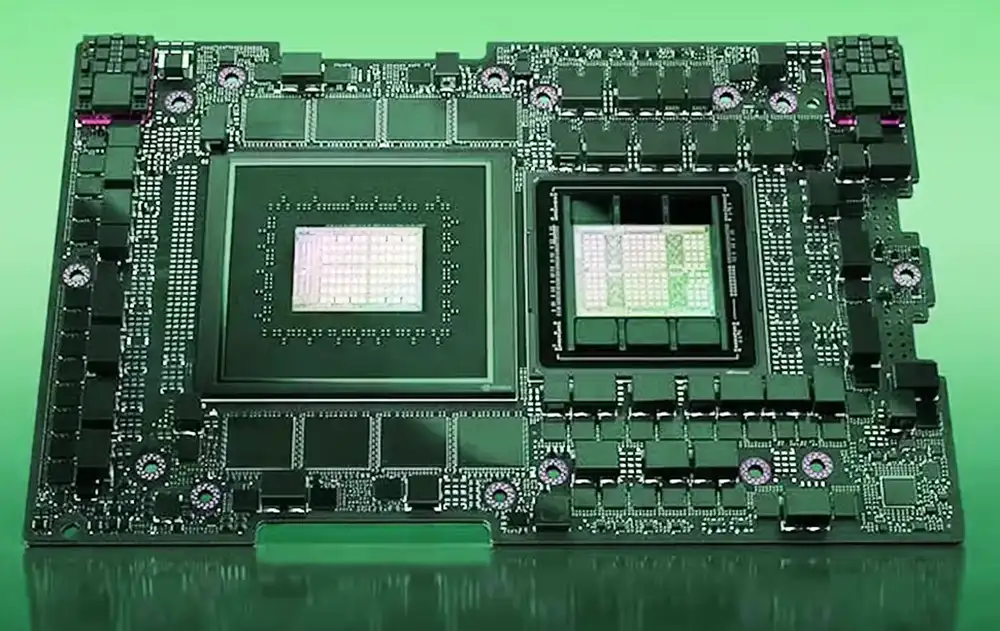

Ranije prošle nedelje na COMPUTEX-u, Nvidia je objavila da je novi GH200 Grace Hopper „Superčip“ (kombinacija CPU+GPU posebno kreirana za primenu u AI) ušao u punu proizvodnju. Sistem Ima 528 GPU tenzorskih jezgara, podržava do 480GB CPU RAM-a i 96GB GPU RAM-a, dok je propusni opseg magistrale prema GPU memoriji 4TB u sekundi.

Nvidia H100 Hopper je trenutno najmoćniji GPU industrijskog ranga kompanije Nvidia. Pokreće AI modele poput ChatGPT, i predstavlja značajno unapređenje u odnosu na A100 čip iz 2020. godine, koji je pokretao obuku za mnoge generativne AI chatbotove i generatore slika o kojima danas pričamo.

Brži GPU-ovi će omogućiti moćnije generativne AI modele jer mogu paralelno izvoditi više matričnih množenja, što je neophodno za funkcionisanje današnjih veštačkih neuronskih mreža. Osim povećanja broja operacija paralelizacijom u više jezgara, brzina rada (takt) je takođe veća.

GH200 je preuzeo „Hopper“ osnovu i povezao je sa „Grace“ CPU platformom kompanije Nvidia (obe su nazvane po pionirki računarskih nauka Grace Hopper), spajajući sve u jedan sistem kroz Nvidia’s NVLink čip-ka-čipu (C2C) tehnologiju za povezivanja. Nvidia očekuje da će ova kombinacija dramatično ubrzati AI i aplikacije mašinskog učenja, kako u obuci (kreiranju modela), tako i u izvršavanju (proizvodnji rezultata na osnovu obuke i ulaznih podataka).

“Generativni AI modeli ubrzano transformišu poslovanje, otključavaju nove mogućnosti i ubrzavaju otkrića u zdravstvu, finansijama, poslovnim uslugama i mnogim drugim industrijama,” rekao je Ian Buck, potpredsednik za hardversko ubrzanje računanja u Nvidia, u saopštenju za štampu. “Sa Grace Hopper Superčipovima čije proizvodnja počinje punom parom, kompanije širom sveta će imati ubrzanu infrastrukturu koja će omogućiti izgradnju i primenu generativnih AI aplikacija koje koriste njihove jedinstvene podatke.”

Prema kompaniji, ključne karakteristike GH200 uključuju novi 900GB/s koherentni (deljeni) memorijski interfejs, koji je sedam puta brži od PCIe Gen5. GH200 takođe nudi 30 puta veću ukupnu sistemsku memorijsku propusnost prema GPU-u u poređenju sa Nvidia DGX A100. Osim toga, GH200 može pokrenuti sve Nvidia softverske platforme, uključujući Nvidia HPC SDK, Nvidia AI, i Nvidia Omniverse.

Nvidia je istovremeno najavila da će ovaj kombinovani CPU+GPU sistem ugraditi u novi superkompjuter pod nazivom DGX GH200, koji može kombinovati snagu 256 GH200 sistema kako bi delovali kao jedan GPU, pružajući performanse od 1 exaflop i 144 terabajta deljene memorije, što je skoro 500 puta više memorije nego kod prethodne generacije Nvidia DGX A100.

DGX GH200 će biti sposoban da obučava ogromne modele sledeće generacije AI (je li neko rekao GPT-6?) za generativne jezičke aplikacije, sisteme preporuka i analizu podataka. Nvidia nije objavila cenu za GH200, ali prema analizama stručnjaka upućenih u performanse i cenovnu politiku kompanije, jedan DGX GH200 računar „može lako koštati niži osmocifren iznos“.

Ukupno gledano, razumno je reći da će, zahvaljujući stalnom napretku hardvera od strane dobavljača kao što su Nvidia i Cerebras, visokokvalitetni cloud AI modeli verovatno nastaviti da postaju sposobniji tokom vremena, obrađujući više podataka, mnogo brže nego pre.