Naučnici nailaze na mnogo kompromisa pokušavajući da izgrade i povećaju sisteme nalik mozgu koji mogu da izvode mašinsko učenje. Na primer, veštačke neuronske mreže su sposobne da nauče složene zadatke jezika i vida, ali proces obuke računara za obavljanje ovih zadataka je spor i zahteva mnogo snage.

Mašine za obuku da uče digitalno, ali obavljaju zadatke analogno – što znači da ulaz varira u zavisnosti od fizičke veličine, kao što je napon – može smanjiti vreme i snagu, ali male greške se mogu brzo povećati.

Električna mreža koju su istraživači fizike i inženjerstva sa Univerziteta u Pensilvaniji ranije dizajnirali je skalabilnija jer se greške ne povećavaju na isti način kako veličina sistema raste, ali je ozbiljno ograničena jer može naučiti samo linearne zadatke, tj. sa jednostavnim odnosom između ulaza i izlaza.

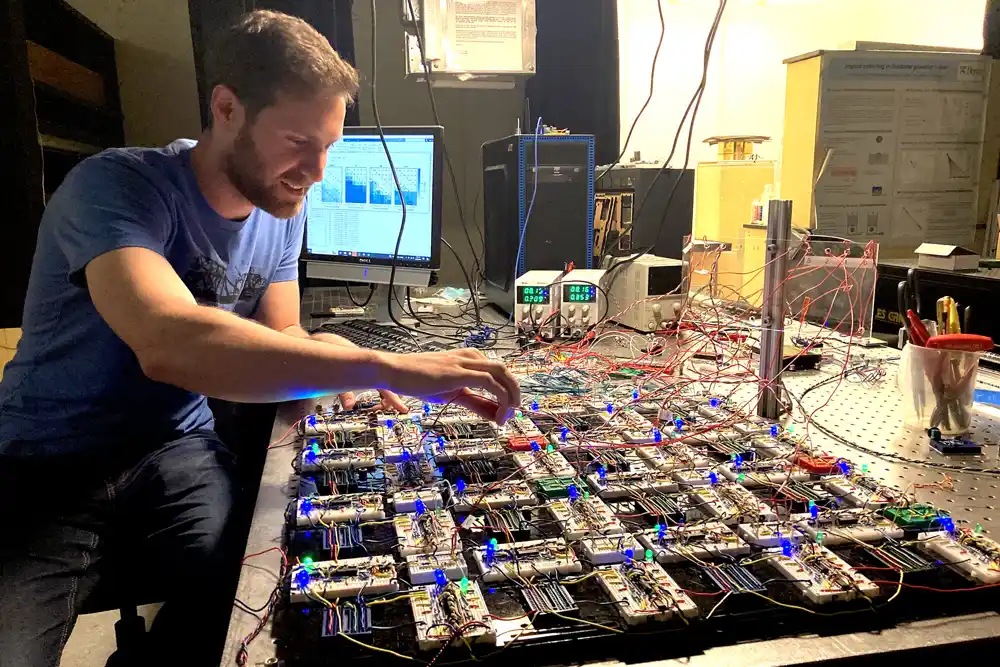

Sada su istraživači kreirali analogni sistem koji je brz, male snage, skalabilan i sposoban da nauči složenije zadatke, uključujući „ekskluzivne ili“ odnose (KSOR) i nelinearnu regresiju. Ovo se zove kontrastivna lokalna mreža učenja; komponente se razvijaju same od sebe na osnovu lokalnih pravila bez poznavanja veće strukture.

Profesor fizike Douglas J. Durian to upoređuje sa kako neuroni u ljudskom mozgu ne znaju šta drugi neuroni rade, a ipak se pojavljuje učenje.

„Može naučiti, u smislu mašinskog učenja, da obavlja korisne zadatke, slične računarskoj neuronskoj mreži, ali je fizički objekat“, kaže fizičar Sem Dilavu, postdoktor u Durian Research Group i prvi autor rada o sistem objavljen u časopisu PNAS.

„Jedna od stvari zbog kojih smo zaista uzbuđeni je da, zato što nema znanja o strukturi mreže, veoma je tolerantna na greške, veoma je robusna da se pravi na različite načine, i mislimo da to mnogo otvara mogućnosti da se ove stvari povećaju“, kaže profesor inženjerstva Mark Z. Miskin.

„Mislim da je to idealan model sistema koji možemo proučavati da bismo stekli uvid u sve vrste problema, uključujući biološke probleme“, kaže profesor fizike Andrea J. Liu. Ona takođe kaže da bi to moglo biti od pomoći u povezivanju sa uređajima koji prikupljaju podatke koji zahtevaju obradu, kao što su kamere i mikrofoni.

U radu, autori kažu da njihov sistem za samoučenje „pruža jedinstvenu priliku za proučavanje učenja u nastajanju. U poređenju sa biološkim sistemima, uključujući mozak, naš sistem se oslanja na jednostavniju, dobro shvaćenu dinamiku, precizno se može obučiti i koristi jednostavne modularne komponente.“

Ovo istraživanje je zasnovano na okviru Coupled Learning okvira koji su osmislili Liu i postdok Menahem (Nači) Stern, objavljujući svoje nalaze 2021. godine. U ovoj paradigmi, fizički sistem koji nije dizajniran da ostvari određeni zadatak prilagođava se primenjenim inputima da bi naučio zadatak, dok koristi lokalna pravila učenja i nema centralizovani procesor.

Dilavu kaže da je došao u Penn posebno zbog ovog projekta i radio je na prevođenju okvira sa rada u simulaciji na rad u njegovom trenutnom fizičkom dizajnu, koji se može napraviti korišćenjem standardnih komponenti kola.

„Jedan od najluđih delova u vezi sa ovim je to što se stvar zaista uči sama; mi je samo na neki način pripremamo za rad“, kaže Dilavu. Istraživači unose samo napone kao ulaz, a zatim tranzistori koji povezuju čvorove ažuriraju svoja svojstva na osnovu pravila Coupled Learning.

„Zato što je način na koji i izračunava i uči zasnovan na fizici, mnogo je razumljiviji“, kaže Miskin. „Možete zapravo da shvatite šta pokušava da uradi jer dobro upravljate osnovnim mehanizmom. To je nekako jedinstveno jer su mnogi drugi sistemi za učenje crne kutije u kojima je mnogo teže znati zašto je mreža uradila to što je uradila.“ “

Durian kaže da se nada da je ovo „početak ogromnog polja“, napominjući da još jedan postdoktor u njegovoj laboratoriji, Lauren Altman, gradi mehaničke verzije kontrastnih lokalnih mreža za učenje.

Istraživači trenutno rade na povećanju dizajna, a Liu kaže da postoji mnogo pitanja o trajanju memorije, efektima buke, najboljoj arhitekturi za mrežu i da li postoje bolji oblici nelinearnosti.

„Nije baš jasno šta se menja dok povećavamo sistem učenja“, kaže Miskin.

„Ako pomislite na mozak, postoji ogroman jaz između crva sa 300 neurona i ljudskog bića, i nije očigledno gde se te sposobnosti pojavljuju, kako se stvari menjaju kako se povećavate. Imati fizički sistem koji možete učiniti većim i sve veći i veći i veći je prilika da se to zaista prouči.“