Zamislite da skrolujete kroz fotografije na telefonu i naiđete na sliku koju u početku ne možete da prepoznate. Izgleda da je možda nešto nejasno na kauču; može li to biti jastuk ili kaput? Posle nekoliko sekundi klikće – naravno! To klupko paperja je mačka tvog prijatelja, Moka. Dok su neke vaše fotografije mogle da se razumeju u trenu, zašto je ova fotografija mačke bila mnogo teža?

Istraživači Laboratorije za računarske nauke i veštačku inteligenciju MIT (CSAIL) bili su iznenađeni kada su otkrili da je, uprkos kritičnoj važnosti razumevanja vizuelnih podataka u ključnim oblastima, od zdravstvene zaštite do transporta do kućnih uređaja, pojam teškoća prepoznavanja slike za ljude skoro u potpunosti ignorisano.

Jedan od glavnih pokretača napretka u veštačkoj inteligenciji zasnovanoj na dubokom učenju bili su skupovi podataka, ali mi malo znamo o tome kako podaci pokreću napredak u dubokom učenju velikih razmera osim što je veće to bolje.

U aplikacijama iz stvarnog sveta koje zahtevaju razumevanje vizuelnih podataka, ljudi nadmašuju modele prepoznavanja objekata uprkos činjenici da se modeli dobro ponašaju na trenutnim skupovima podataka, uključujući one koji su eksplicitno dizajnirani da izazovu mašine sa pogrešnim slikama ili pomerama distribucije.

Ovaj problem i dalje postoji, delimično zato što nemamo uputstva o apsolutnoj težini slike ili skupa podataka. Bez kontrole težine slika koje se koriste za evaluaciju, teško je objektivno proceniti napredak ka performansama na nivou čoveka, pokriti opseg ljudskih sposobnosti i povećati izazov koji predstavlja skup podataka.

Da bi popunio ovu prazninu u znanju, David Maio, doktor nauka sa MIT-a. student elektrotehnike i računarstva i član CSAIL-a, uronio je u duboki svet skupova slika, istražujući zašto je ljudima i mašinama teže prepoznati određene slike od drugih.

„Nekim slikama inherentno je potrebno više vremena da se prepoznaju, a od suštinskog je značaja da se razume aktivnost mozga tokom ovog procesa i njegov odnos sa modelima mašinskog učenja. Možda postoje složena neuronska kola ili jedinstveni mehanizmi koji nedostaju u našim trenutnim modelima, vidljivi samo kada se testiraju sa izazovnim vizuelnim stimulanse. Ovo istraživanje je ključno za razumevanje i poboljšanje modela mašinskog vida“, kaže Mejo, vodeći autor novog rada o radu.

Ovo je dovelo do razvoja nove metrike, „minimalnog vremena gledanja“ (MVT), koji kvantifikuje poteškoće u prepoznavanju slike na osnovu toga koliko dugo osoba treba da je pogleda pre nego što izvrši ispravnu identifikaciju.

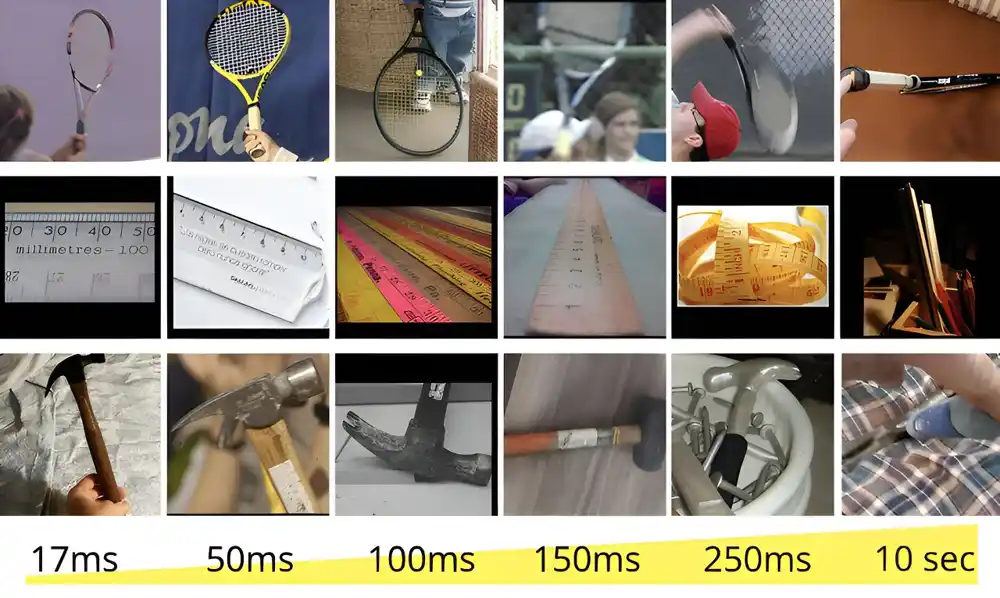

Koristeći podskup ImageNet-a, popularnog skupa podataka u mašinskom učenju, i ObjectNet-a, skupa podataka dizajniranog da testira robusnost prepoznavanja objekata, tim je pokazao slike učesnicima u različitom trajanju od samo 17 milisekundi do čak 10 sekundi i zamolio ih da izaberite tačan objekat iz skupa od 50 opcija.

Nakon preko 200.000 pokušaja prezentacije slika, tim je otkrio da su postojeći setovi testova, uključujući ObjectNet, izgledali nagnuti ka lakšim, kraćim MVT slikama, pri čemu je velika većina performansi referentnih vrednosti izvedena iz slika koje su lake za ljude.

Projekat je identifikovao zanimljive trendove u performansama modela—posebno u odnosu na skaliranje. Veći modeli su pokazali značajno poboljšanje na jednostavnijim slikama, ali su ostvarili manji napredak na zahtevnijim slikama. CLIP modeli, koji uključuju i jezik i viziju, isticali su se dok su se kretali u pravcu prepoznavanja nalik čoveku.

„Tradicionalno, skupovi podataka za prepoznavanje objekata bili su nagnuti ka manje složenim slikama, što je praksa koja je dovela do inflacije u metrikama performansi modela, što ne odražava zaista robusnost modela ili njegovu sposobnost da se uhvati u koštac sa složenim vizuelnim zadacima. Naše istraživanje otkriva da teže slike predstavljaju akutniji izazov, uzrokujući promenu distribucije koja se često ne uzima u obzir u standardnim evaluacijama“, kaže Mejo.

„Izdali smo skupove slika označene po težini zajedno sa alatkama za automatsko izračunavanje MVT-a, omogućavajući da se MVT doda postojećim testovima i proširi na različite aplikacije. To uključuje merenje težine skupa testova pre primene sistema u stvarnom svetu, otkrivanje neuronskih korelata težine slike, i unapređenje tehnika prepoznavanja objekata kako bi se zatvorio jaz između referentnih vrednosti i performansi u stvarnom svetu.“

„Jedan od mojih najvećih zaključaka je da sada imamo drugu dimenziju za procenu modela. Želimo modele koji mogu da prepoznaju bilo koju sliku čak i ako je – možda posebno ako – čoveku teško da je prepozna. Mi smo prvi koji su kvantifikovali šta bi to značilo. Naši rezultati pokazuju da ne samo da to nije slučaj sa današnjim stanjem tehnike, već i da naše trenutne metode evaluacije nemaju mogućnost da nam kažu kada je to slučaj jer su standardni skupovi podataka toliko iskrivljeni ka lakim slikama“, kaže Džesi Kamings, diplomirani student elektrotehnike i računarstva na MIT-u i prvi autor sa Mejom na radu.

Pre nekoliko godina, tim koji stoji iza ovog projekta identifikovao je značajan izazov u oblasti mašinskog učenja: modeli su se borili sa slikama van distribucije ili slikama koje nisu bile dobro predstavljene u podacima o obuci. Unesite ObjectNet, skup podataka koji se sastoji od slika prikupljenih iz podešavanja iz stvarnog života.

Skup podataka je pomogao da se osvetli jaz u performansama između modela mašinskog učenja i sposobnosti prepoznavanja ljudi tako što je eliminisao lažne korelacije prisutne u drugim merilima — na primer, između objekta i njegove pozadine. ObjectNet je osvetlio jaz između performansi modela mašinskog vida na skupovima podataka i u realnim aplikacijama, podstičući upotrebu za mnoge istraživače i programere — što je kasnije poboljšalo performanse modela.

Brzo napred u sadašnjost, i tim je napravio korak dalje u istraživanju sa MVT-om. Za razliku od tradicionalnih metoda koje se fokusiraju na apsolutne performanse, ovaj novi pristup procenjuje performanse modela upoređujući njihove odgovore na najlakše i najteže slike.

Studija je dalje istraživala kako se teškoće slike mogu objasniti i testirati na sličnost sa ljudskom vizuelnom obradom. Koristeći metrike kao što su c-score, dubina predviđanja i otpornost na suprotstavljanje, tim je otkrio da mreže obrađuju teže slike drugačije. „Iako postoje uočljivi trendovi, kao što su lakše slike koje su prototipnije, sveobuhvatno semantičko objašnjenje poteškoća sa slikama i dalje izmiče naučnoj zajednici“, kaže Mejo.

U oblasti zdravstvene zaštite, na primer, relevantnost razumevanja vizuelne složenosti postaje još izraženija. Sposobnost AI modela da tumače medicinske slike, kao što su rendgenski snimci, podložna je raznolikosti i distribuciji poteškoća. Istraživači se zalažu za preciznu analizu distribucije poteškoća prilagođenu profesionalcima, osiguravajući da se sistemi veštačke inteligencije procenjuju na osnovu stručnih standarda, a ne na tumačenjima laika.

Mejo i Kamings trenutno takođe razmatraju neurološke osnove vizuelnog prepoznavanja, istražujući da li mozak pokazuje različitu aktivnost prilikom obrade lakih i izazovnih slika. Studija ima za cilj da otkrije da li složene slike regrutuju dodatne oblasti mozga koje obično nisu povezane sa vizuelnom obradom, nadamo se da će pomoći da se demistifikuje kako naš mozak tačno i efikasno dekodira vizuelni svet.

Gledajući unapred, istraživači nisu fokusirani samo na istraživanje načina da se poboljšaju prediktivne sposobnosti veštačke inteligencije u vezi sa poteškoćom slike. Tim radi na identifikaciji korelacija sa poteškoćama u vremenu gledanja kako bi generisao teže ili lakše verzije slika.

Uprkos značajnom napretku studije, istraživači priznaju ograničenja, posebno u smislu odvajanja prepoznavanja objekata od zadataka vizuelnog pretraživanja. Trenutna metodologija se koncentriše na prepoznavanje objekata, izostavljajući složenost koju unose pretrpane slike.

„Ovaj sveobuhvatni pristup se bavi dugogodišnjim izazovom objektivne procene napretka ka performansama na ljudskom nivou u prepoznavanju objekata i otvara nove puteve za razumevanje i unapređenje polja“, kaže Mejo.

„Sa potencijalom da prilagodi metriku težine minimalnog vremena gledanja za različite vizuelne zadatke, ovaj rad utire put za robusnije performanse nalik ljudima u prepoznavanju objekata, osiguravajući da su modeli zaista stavljeni na test i spremni za složenosti vizuelnog razumevanja stvarnog sveta“.

„Ovo je fascinantna studija o tome kako ljudska percepcija može da se koristi za identifikaciju slabosti u načinima na koji se modeli vizije veštačke inteligencije obično ocenjuju, koji precenjuju performanse AI koncentrišući se na lake slike“, kaže Alan L. Iuille, ugledni profesor kognitivnih nauka Bloomberg-a i Računarske nauke na Univerzitetu Džons Hopkins, koji nije bio uključen u rad.

„Ovo će pomoći da se razviju realističnija merila koja vode ne samo ka poboljšanju AI, već i da se napravi pravednija poređenja između AI i ljudske percepcije.

„Široko se tvrdi da sistemi kompjuterskog vida sada nadmašuju ljude, a na nekim referentnim skupovima podataka to je tačno“, kaže član tehničkog osoblja Anthropic dr Simon Kornblith. ’17, koji takođe nije bio uključen u ovaj posao.

„Međutim, veliki deo poteškoća u tim merilima potiče od nejasnoće onoga što je na slikama; prosečna osoba jednostavno ne zna dovoljno da klasifikuje različite rase pasa. Ovaj rad se umesto toga fokusira na slike koje ljudi mogu dobiti samo ako daju dovoljno vremena. Ove slike su generalno mnogo teže za sisteme kompjuterskog vida, ali najbolji sistemi su samo malo gori od ljudi.“